Avez-vous déjà connu le syndrome de la page blanche ? Vous avez souhaité que votre ordinateur puisse vous comprendre et vous aider ? Désormais, grâce au traitement du langage naturel, une forme d’intelligence artificielle, nous disposons d’un certain nombre d’outils d’écriture IA pour nous aider.

L’un des algorithmes les plus puissants et les plus connus pour l’écriture IA est le GPT-3. Dans cet article, nous allons vous en dire plus sur GPT-3 et, nous l’espérons, vous le comprendrez mieux.

Qu’est-ce que GPT-3 ?

Vous avez peut-être entendu parler de GPT-3, mais vous ne savez pas ce que cela signifie. GPT-3 est un ensemble de modèles d’apprentissage automatique qui comprend et génère le langage naturel. GPT-3 est l’acronyme de « Generative Pre-trained Transformer third generation ».

Avec ce générateur de texte créé par OpenAI, vous pouvez générer de grands volumes de textes pertinents et sophistiqués en utilisant seulement une petite quantité de texte en entrée.

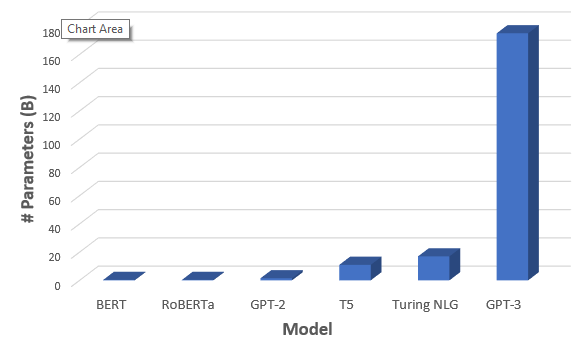

Avec plus de 175 milliards de paramètres d’apprentissage automatique, le réseau neuronal d’apprentissage profond de GPT -3 est l’un des plus grands réseaux neuronaux au monde. Comparez cela au modèle Turing NLG de Microsoft, qui comptait 17 milliards de paramètres. Avant GPT-3, c’était le plus grand modèle de langage entraîné.

Début 2021, GPT-3 est devenu le plus grand réseau neuronal jamais créé. Pour cette raison, GPT-3 parvient mieux que tout autre modèle précédent à produire un texte qui semble avoir été écrit par un humain.

Qui a créé GPT-3 ?

Le 11 juin 2020, OpenAI a publié l’API du modèle d’écriture GPT-3 pour tout le monde. Il s’agit de la plus grande mise à jour depuis la sortie de ses prédécesseurs, GPT-2 et GPT-1. Il contient une compréhension beaucoup plus profonde du langage et du texte que le modèle GPT- 2.0.

La traduction de langues, la réponse à des questions et la classification de textes ne sont que quelques-unes des tâches dont GPT-3 est capable.

OpenAI vise à promouvoir et à développer une intelligence artificielle sûre au profit de l’humanité. Les fondateurs envisagent OpenAI comme une extension de la volonté humaine au profit de l’humanité.

GPT-3 est un ensemble de modèles d’apprentissage automatique à base de réseaux neuronaux qui génèrent du texte à partir de données tirées d’Internet et de peu d’informations fournies par l’utilisateur.

La plupart des outils de rédaction assistée par ordinateur utilisent GPT-3 comme générateur de texte sous-jacent.

Comment fonctionne GPT-3 ?

Imaginez que vous enseignez une langue à un enfant. Les enfants ont tendance à apprendre une langue « de bas en haut », en testant des mots absurdes pour former une phrase. Un adulte les corrige et leur indique la version correcte du mot à utiliser.

Le TPG-3 fonctionne de la même manière. Il remplit les blancs avec des mots pour créer une phrase et ajuste continuellement les mots jusqu’à ce que sa programmation lui donne le feu vert.

Dans le monde de l’intelligence artificielle, le GPT-3 vit dans le monde du traitement du langage naturel (NLP).

Les bases du traitement du langage naturel

Le traitement du langage naturel (NLP) se concentre sur l’utilisation du langage humain naturel dans le contexte de l’informatique.

De nombreux types de tâches de traitement du langage peuvent relever du traitement du langage naturel :

- Analyse du sentiment

- Reconnaissance vocale

- Traduction automatique

- Génération de texte

- Résumé de texte

Le langage humain est incroyablement nuancé et complexe. Il existe souvent de nombreux mots qui se ressemblent ou qui ont des significations différentes selon le contexte. Il peut donc être difficile pour les gens de communiquer efficacement, surtout s’ils ne sont pas familiers avec la langue.

Par exemple, le mot « droit » peut signifier à la fois correct et opposé à gauche, tandis que le mot « gauche » peut signifier à la fois maladroit et opposé à droite.

Ces exemples soulignent combien il est important de connaître les différents sens des mots lorsqu’on communique avec d’autres personnes. Sans cette compréhension, il existe un risque de mauvaise communication et de malentendu.

Pour un anglophone de naissance, comprendre les différents sens et contextes des mots ci-dessus semble élémentaire. Cependant, il est très difficile pour une machine de comprendre cela.

La façon d’enseigner à une machine est de la programmer.

Que fait GPT-3 en coulisses ?

Bien que GPT-3 soit un système NLP conçu pour une utilisation générale, il fait une chose fondamentale : il prédit ce qui va suivre, sur la base du texte qui lui est donné.

Comment la programmation sait-elle ce qui est bon ou mauvais ? Des paramètres et des règles complexes régissent la technologie. De plus, elle a été entraînée sur plus de 45 To de données provenant d’Internet afin de connaître les modèles utilisés par les gens.

Basé sur le pré-entraînement d’une énorme quantité de texte, GPT-3 est la troisième version d’un modèle qui génère des textes basés sur l’IA.

Le système analyse les entrées de l’utilisateur et crée la sortie la plus probable en analysant la langue. Le modèle produit un texte de haute qualité qui ressemble à un texte humain, même sans beaucoup de réglages ou d’entraînement supplémentaire.

Exemples d’outils GPT-3

L’utilisation efficace des outils de l’API GPT-3 n’est pas une tâche facile. Il faut beaucoup de temps et d’efforts pour apprendre à utiliser ces outils correctement. Cependant, tout le monde peut s’inscrire sur le site d’OpenAI pour y avoir accès.

La raison pour laquelle la plupart des gens utilisent GPT-3 est qu’il vous permet de créer des modèles d’apprentissage profond sans avoir à former vos propres modèles de langage, ce qui demande une énorme quantité de ressources informatiques.

En plus de GPT-3, il existe déjà de nombreuses solutions innovantes, notamment pour la création de contenu, la rédaction, l’autocomplétion et les chatbots. Les innovateurs de produits bien établis ont utilisé GPT-3 pour créer des solutions passionnantes. Chaque jour, de nouveaux types de solutions apparaissent sur la base de la technologie GPT-3.

Quelles sont les capacités de GPT-3 ?

En tant que composant majeur du traitement du langage naturel, la génération du langage naturel génère des textes naturels en langues humaines. Elle génère des textes humains réalistes en utilisant des données provenant d’Internet. Les machines ne peuvent pas vraiment comprendre les nuances et les complexités du langage, c’est pourquoi la génération de contenu adapté aux humains est un défi.

Avec quelques lignes de texte en entrée, GPT-3 produit des articles, de la poésie, des histoires, des reportages et des dialogues de qualité à partir d’une petite quantité de texte.

Plutôt que de créer uniquement des documents en langage humain, GPT-3 peut créer tout texte contenant une structure textuelle. Il peut également produire automatiquement des résumés de texte et des codes. GPT-3 est également utilisé pour automatiser des tâches quotidiennes, comme la génération d’un nouveau morceau de texte basé sur le contexte du texte tapé dans l’ordinateur.

Quels sont les points forts de GPT-3 ?

GPT-3 offre une bonne solution pour générer de grandes quantités de texte à partir de petites quantités de données saisies par une machine. L’utilisation d’un humain pour la génération de texte n’est pas toujours pratique ou efficace, et la génération automatique de texte qui semble humain pourrait être la meilleure option. GPT-3 peut être utilisé de diverses manières par différents services, tels que les centres de service clientèle, les équipes de vente et les équipes de marketing, pour répondre aux questions et établir des liens avec les clients.

En envoyant simplement quelques lignes de code, GPT-3 peut créer un code exploitable qui peut s’exécuter sans erreur. En outre, GPT-3 a également été utilisé pour créer des maquettes de sites Web avec succès. En quelques phrases, un développeur peut décrire un site Web à l’aide de Figma et de GPT-3 en ajoutant simplement du texte suggéré.

Le site Web d’Open AI présente un certain nombre d’exemples intéressants d’applications GPT-3, notamment des joueurs qui utilisent GPT-3 pour créer des dialogues de chat réalistes, des quiz, des images et d’autres graphiques à partir de suggestions de texte. GPT-3 peut également créer des bandes dessinées, des mèmes et des recettes.

Voici d’autres points forts de GPT-3 :

1. C’est un outil puissant pour la formation et le test d’ensembles de données avec des caractéristiques riches et des interactions complexes.

2. Il peut être appliqué à des problèmes complexes dans de nombreux domaines, notamment les sciences biomédicales et sociales.

3. L’écriture GPT-3 AI possède un riche ensemble de fonctionnalités qui permet de représenter un large éventail de phénomènes, tels que le traitement du langage naturel, la vision par ordinateur, la reconnaissance vocale, etc.

4. Elle est conçue pour donner de bons résultats tant sur de petits ensembles de données où le nombre d’exemples requis pour l’entraînement est faible que sur de grands ensembles de données où de nombreux exemples sont requis pour l’entraînement (par exemple, des milliers ou même des millions d’instances).

Quelles sont les faiblesses de GPT-3 ?

La taille et la puissance de GPT-3 sont remarquables, mais elles s’accompagnent également de plusieurs limites et risques. Le principal problème est que le GPT-3 n’apprend pas de manière continue. Contrairement à un humain, elle ne dispose pas d’une mémoire à long terme permanente qui se conserve à chaque interaction.

Il s’appuie sur les données qui l’ont formé et, dans les recherches que j’ai effectuées, la plupart des données de formation provenant d’Internet allaient jusqu’en 2019. Un autre problème du TPG-3 est qu’il est incapable d’expliquer pourquoi certaines entrées donnent lieu à des sorties spécifiques, comme le font tous les réseaux neuronaux.

Un deuxième problème est la taille d’entrée limitée associée aux architectures de transformation, telles que GPT-3. Certaines applications ne peuvent pas gérer une grande quantité de texte en entrée, ce qui peut limiter leur utilisation. Quelques phrases de texte en entrée sont la longueur maximale pour GPT-3. Puisque GPT-3 génère lentement des modèles à partir des résultats, le temps d’inférence est également lent.

Les biais d’apprentissage automatique de GPT-3 sont encore plus préoccupants. Le modèle a été formé en utilisant du texte Internet, il présente donc un certain nombre de préférences qui seraient présentes chez les humains s’ils utilisaient du texte Internet comme source de texte. Il donne aux groupes radicaux la possibilité d’automatiser leurs discours de haine. En outre, la qualité du texte généré est suffisamment élevée pour que l’on craigne que GPT-3 soit utilisé à mauvais escient pour créer des « fake news ».

Réflexions finales

Dans l’ensemble, GPT-3 AI est un outil d’apprentissage automatique impressionnant qui présente un certain nombre de forces et de faiblesses. Sa capacité à générer de grandes quantités de texte à partir d’une petite entrée par une machine est particulièrement remarquable.

Cependant, sa dépendance à l’égard des données qui l’ont formé et la taille limitée de ses entrées sont des faiblesses potentielles qui doivent être prises en compte. En outre, les biais de l’apprentissage automatique dans GPT-3 présentent un certain nombre de problèmes qui doivent être résolus avant que cet outil puisse être largement utilisé.

Malgré ces problèmes, le potentiel de l’écriture GPT-3 est passionnant et son impact sur l’industrie sera fascinant à observer.

Avec des recherches et des développements supplémentaires, le GPT-3 peut devenir un outil encore plus puissant à l’avenir.